Giới Thiệu

Bạn có bao giờ tự hỏi, những chatbot AI “thông minh” như ChatGPT, Gemini, và Claude thực sự hiểu những gì chúng đang nói, hay chỉ đơn giản là bắt chước?

Đó là câu hỏi khiến không chỉ các triết gia đau đầu từ nhiều thế kỷ nay, mà còn làm tốn không ít giấy mực của báo chí hiện đại khi nói về các Mô hình Ngôn ngữ Lớn (LLM). Thoạt nhìn, thật khó tin khi một cỗ máy chỉ biết “ghép chữ” lại có thể hiểu được ý nghĩa sâu xa của ngôn ngữ. Giống như con vẹt học nói tiếng người, chúng có thể nói vanh vách mà chẳng hiểu mình đang nói gì.

Nhà khoa học nhận thức Douglas Hofstadter từng nhận định: “AI chỉ đơn thuần là việc tạo ra những cỗ máy có thể thực hiện những điều mà con người cần đến trí thông minh để làm.” LLM rõ ràng đã đạt được những thành tựu đáng kinh ngạc trong việc “bắt chước” trí thông minh con người, từ việc sáng tác thơ ca đến viết code.

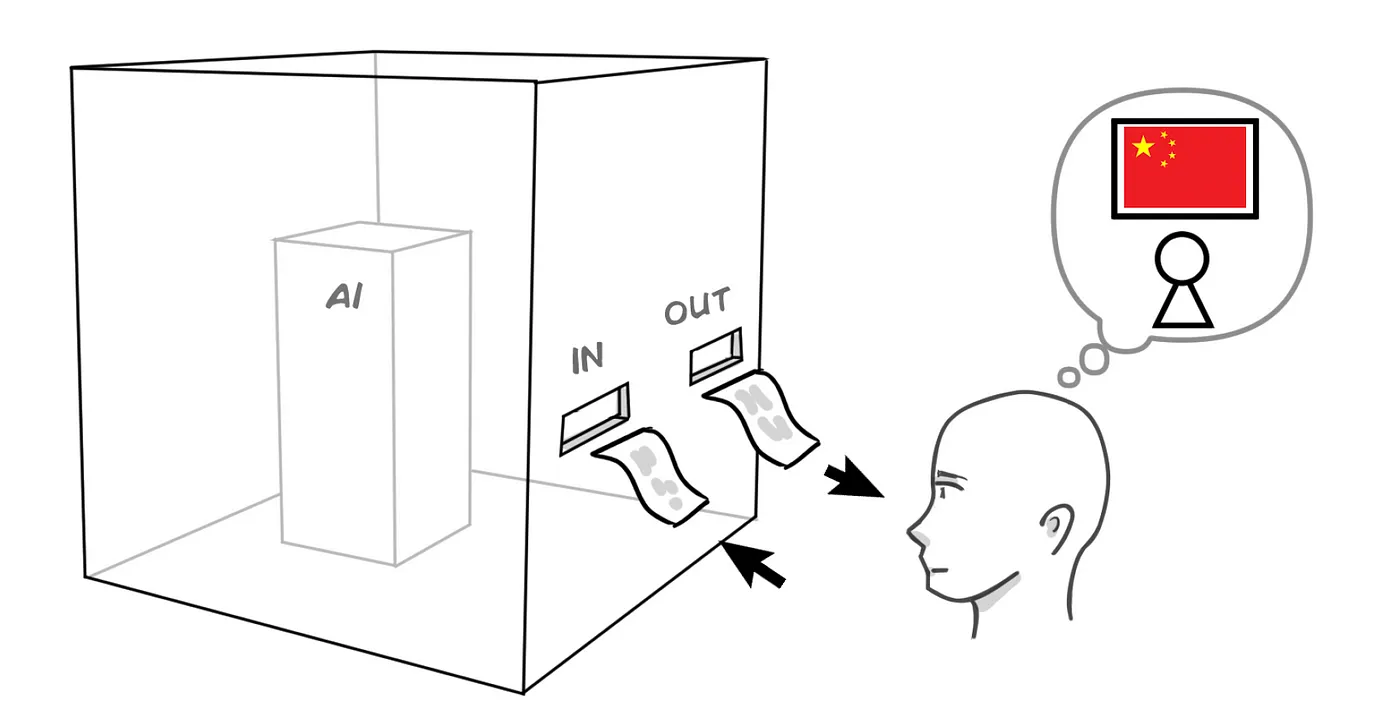

Để minh họa cho sự khác biệt này, vào năm 1980 triết gia John Searle đã đưa ra một thí nghiệm tưởng tượng rất thú vị:

Hãy hình dung một người không biết tiếng Trung Quốc bị nhốt trong phòng kín, chỉ có một cuốn sổ tay hướng dẫn cách ghép các ký tự tiếng Trung với nhau. Khi có người đưa câu hỏi bằng tiếng Trung Quốc qua khe cửa, người này chỉ việc tra cứu trong sổ tay và đưa ra câu trả lời, cũng bằng tiếng Trung Quốc. Liệu có thể nói người đó "hiểu" tiếng Trung Quốc hay không?

Searle cho rằng không, và ông gọi đây là thí nghiệm “Căn phòng tiếng Trung Quốc“.

Tương tự, nhiều người cho rằng LLM cũng chỉ là “căn phòng Trung Quốc” phiên bản kỹ thuật số. Như Yann LeCun, cha đẻ của mạng nơ-ron tích chập, đã nói: “Các mô hình ngôn ngữ lớn rất tốt trong việc bắt chước ngôn ngữ, nhưng chúng không có mô hình thế giới thực.” Chúng chỉ biết xử lý các ký tự, từ ngữ như những “hình thức” vô hồn, mà không thể nắm bắt được mối liên hệ giữa chúng với thế giới thực, điều tạo nên ý nghĩa đích thực của ngôn ngữ.

Nhà vật lý lý thuyết Michio Kaku từng có một tiên đoán đầy lạc quan: “Trong tương lai, robot sẽ có thể suy nghĩ, sáng tạo, và thậm chí có ý thức.” Phải chăng LLM đang tiến gần đến viễn cảnh đó, hay chúng ta đang kỳ vọng quá nhiều vào những cỗ máy “học vẹt” tinh vi?

Đó chính là điều mà bài viết này sẽ cùng bạn khám phá.

Không gian xác suất

Khác với con người, LLM không có “ý thức” hay “trải nghiệm sống” để hiểu ý nghĩa của ngôn từ. Vậy, chúng làm điều đó bằng cách nào?

LLM “Giải mã” Thông tin như Thế nào?

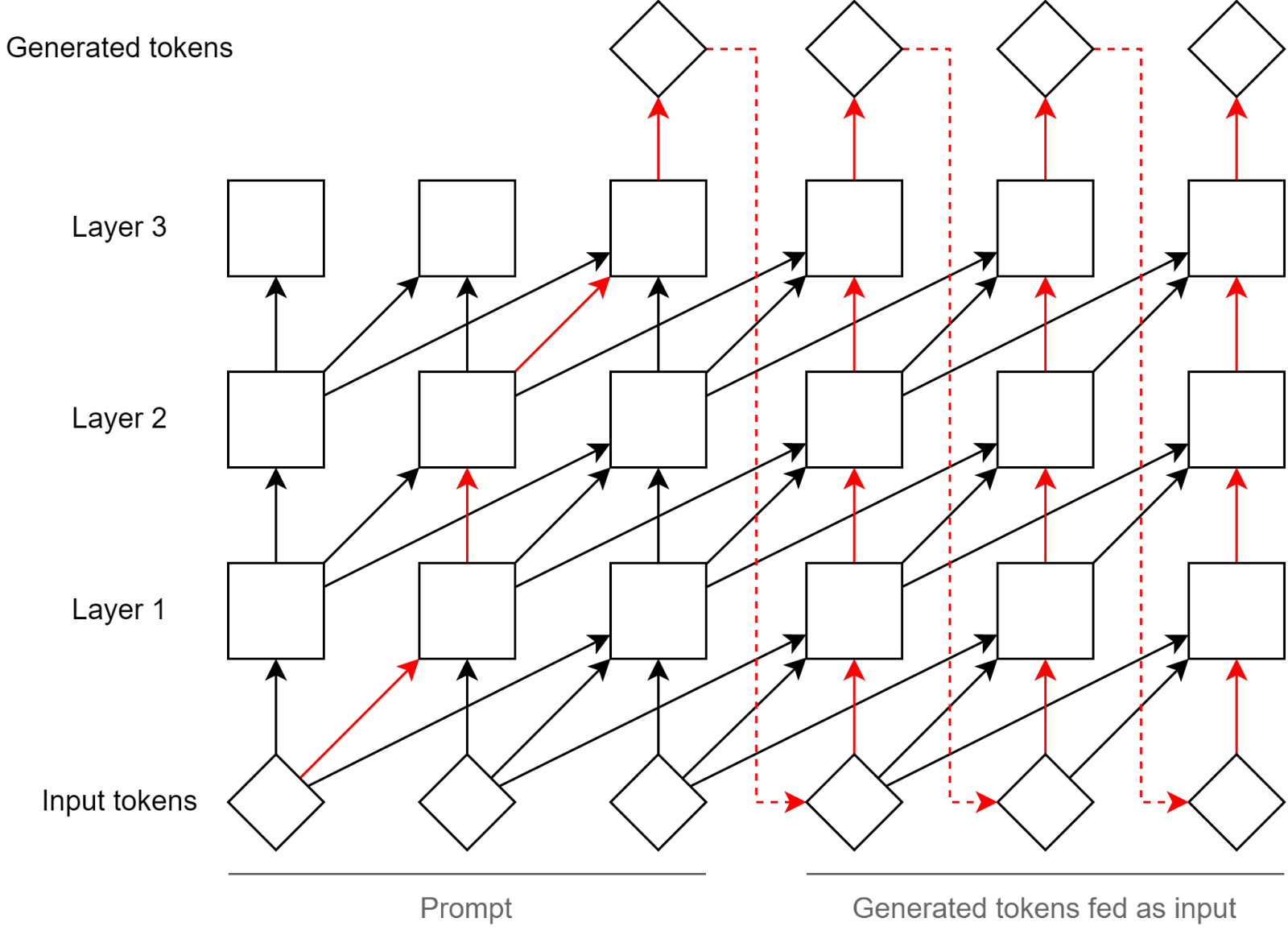

Các mô hình ngôn ngữ lớn (LLM) ngày nay thường hoạt động theo kiểu “chỉ giải mã” (decoder-only). Nói một cách đơn giản, thay vì “mã hóa” (encode) thông tin thành một dạng rút gọn như các mô hình “chỉ mã hóa” (encoder-only) hoặc “mã hóa-giải mã” (encoder-decoder), chúng lại trải rộng thông tin về các từ ngữ trên khắp mạng lưới “nơ-ron” của mình.

Ví dụ mỗi từ như một bản nhạc, được chơi bởi nhiều nhạc cụ khác nhau trong một dàn nhạc khổng lồ. Mỗi "nhạc cụ" này là một phần nhỏ trong mô hình, góp phần tạo nên "âm thanh" tổng thể của từ đó. Cụ thể hơn, chúng biểu diễn các từ theo cách phân tán trên nhiều layers và attention heads của một mô hình học máy.

Chính cách kết hợp phức tạp này tạo nên sự khác biệt của các LLM hiện đại. Nhưng điều thú vị là, các nhà khoa học vẫn đang tìm hiểu xem chính xác thì dàn nhạc này “hiểu” ý nghĩa của bản nhạc như thế nào. Bởi vì, thông tin về mỗi từ lại nằm rải rác khắp nơi trong mô hình, không tập trung ở một chỗ cố định nào cả.

"Không gian Xác suất" và "Quỹ đạo": Cách LLM Hiểu Ý nghĩa!

Hãy tưởng tượng mỗi câu lệnh như một điểm khởi đầu, và từ đó có vô số “con đường” khác nhau mà câu chuyện có thể tiếp diễn.

- Mỗi “con đường” này là một chuỗi các từ, hay còn gọi là quỹ đạo (trajectory).

- Tập hợp tất cả các quỹ đạo có thể có tạo nên một không gian xác suất (probability space), nơi mỗi quỹ đạo có một xác suất xuất hiện nhất định.

LLM “hiểu” ý nghĩa bằng cách phân tích không gian xác suất này:

- Các câu có nghĩa tương tự sẽ có xu hướng tạo ra các quỹ đạo tương tự nhau, giống như hai con đường song song dẫn đến cùng một đích đến.

- Ngược lại, các câu có nghĩa khác biệt sẽ tạo ra các quỹ đạo phân kỳ, mỗi câu dẫn đến một “vùng đất” khác biệt trong không gian ngôn ngữ.

Ví dụ, với câu "Trên bàn có...", quỹ đạo "một quyển sách" sẽ có xác suất cao hơn "một con voi" vì dựa trên kiến thức của LLM về thế giới, sách thường xuất hiện trên bàn hơn là voi.

Giả thuyết Phân phối và Vai trò của nó trong LLM

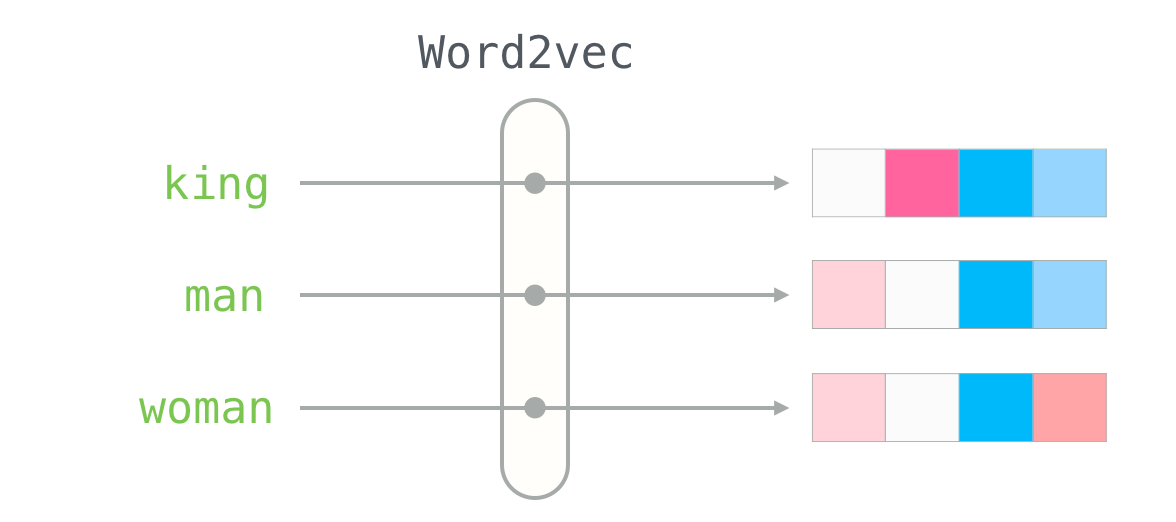

Cách tiếp cận này dựa trên giả thuyết phân phối (distributional hypothesis) trong lĩnh vực xử lý ngôn ngữ tự nhiên (NLP), cho rằng ý nghĩa của một từ được xác định bởi cách nó xuất hiện cùng với các từ khác.

Các phương pháp như nhúng word2vec đã sử dụng giả thuyết này để biểu diễn ý nghĩa của từ dựa trên sự đồng xuất hiện của chúng trong dữ liệu văn bản. Tuy nhiên, với LLM, chúng thể đi xa hơn bằng cách sử dụng chính các phân phối xác suất làm cách biểu diễn ý nghĩa, nhờ khả năng tính toán mạnh mẽ của các mô hình này.

Tính Bất định của Ý nghĩa và Cách LLM Xử lý

“Ý nghĩa không phải là một thứ cố định, mà là một hàm của sự tương tác giữa tâm trí và thế giới,” như triết gia Hilary Putnam đã nói. LLM, với cách tiếp cận độc đáo của mình, đang mở ra một cánh cửa mới để khám phá bản chất của ý nghĩa trong ngôn ngữ.

Tất nhiên, không gian xác suất của một câu là vô hạn, và ngay cả LLM cũng không thể khám phá hết mọi ngóc ngách của nó. Giống như con người, LLM cũng phải đối mặt với tính bất định cơ bản của ý nghĩa (indeterminacy of meaning).

Tuy nhiên, điều thú vị là LLM chỉ cần phân tích một số lượng nhỏ quỹ đạo (khoảng 10-20) để nắm bắt được ý nghĩa cốt lõi của một câu. Điều này tương đồng với cách con người diễn giải ngôn ngữ: khi được hỏi về ý nghĩa của một câu, chúng ta thường diễn đạt lại theo một vài cách khác nhau để làm rõ ý.

LLM: “Tấm Gương Phản Chiếu Tư Duy”

“Ngôn ngữ là một tấm gương phản chiếu tư duy,” như Ludwig Wittgenstein đã viết. Bằng cách phân tích không gian xác suất và quỹ đạo, LLM đang cho chúng ta thấy cách “tư duy” của chúng hoạt động, và đồng thời, đặt ra những câu hỏi mới về bản chất của ý nghĩa và sự hiểu biết trong thế giới AI.

Các thí nghiệm cho thấy phương pháp này đạt hiệu quả cao trong việc đo lường độ tương đồng ngữ nghĩa giữa các câu, vượt trội hơn các phương pháp cạnh tranh khác trên các điểm chuẩn zero-shot về độ tương đồng ngữ nghĩa văn bản (STS – semantic textual similarity).

Điều này cho thấy rằng LLM có khả năng nắm bắt ý nghĩa một cách đáng kể, mở ra tiềm năng to lớn cho việc ứng dụng chúng trong các lĩnh vực như dịch máy, tạo văn bản tự động, và tương tác người-máy.

Hình thức và Nội dung: LLM “Hiểu” Thế giới Theo Cách Riêng

LLM và Giả Thuyết về Sự Hiểu Biết

Liệu các Mô hình Ngôn ngữ Lớn (LLM) có thực sự “hiểu” ý nghĩa, hay chỉ đơn thuần là “bắt chước” một cách tinh vi?

Chúng ta đã thấy rằng LLM có thể phân tích các “quỹ đạo” – những chuỗi từ có thể tiếp nối một câu – để tạo nên một “không gian xác suất” và từ đó suy ra ý nghĩa. Nhưng liệu cách tiếp cận dựa trên xác suất này có phản ánh cách con người chúng ta lĩnh hội ý nghĩa hay không?

Nhiều người hoài nghi cho rằng điều này là không thể. Họ lập luận rằng ý nghĩa không chỉ nằm ở hình thức của ngôn từ, mà còn ở mối liên hệ của nó với thế giới bên ngoài. Nhà triết học John Searle, cha đẻ của thí nghiệm tưởng tượng “Căn phòng tiếng Trung Quốc”, từng khẳng định: “Việc hiểu một ngôn ngữ không chỉ đơn thuần là thao tác các ký hiệu, mà còn là khả năng liên kết các ký hiệu đó với các đối tượng và sự kiện trong thế giới.”

“Ánh xạ” Ý nghĩa: Sự Khác Biệt Giữa Con Người và LLM

Tuy nhiên, hãy thử suy nghĩ theo một cách khác. Khi bạn đọc câu “Trên bàn có một…”, tâm trí bạn không chỉ đơn thuần dự đoán từ tiếp theo có thể là “quyển sách”, “cái ly”, hay “con mèo”. Nó còn gợi lên những hình ảnh, cảm giác, thậm chí cả mùi vị liên quan đến những vật thể đó. Bạn có thể hình dung ra một quyển sách cũ kỹ với mùi giấy bụi bặm, một cái ly thủy tinh mát lạnh với nước cam, hay một chú mèo lông xù đang cuộn tròn ngủ.

Nói cách khác, con người chúng ta “ánh xạ” từ ngữ sang một không gian đa chiều, phong phú hơn nhiều so với không gian văn bản của LLM. Không gian này bao gồm hình ảnh, âm thanh, xúc giác, mùi vị, cảm xúc, và vô vàn những trải nghiệm sống khác.

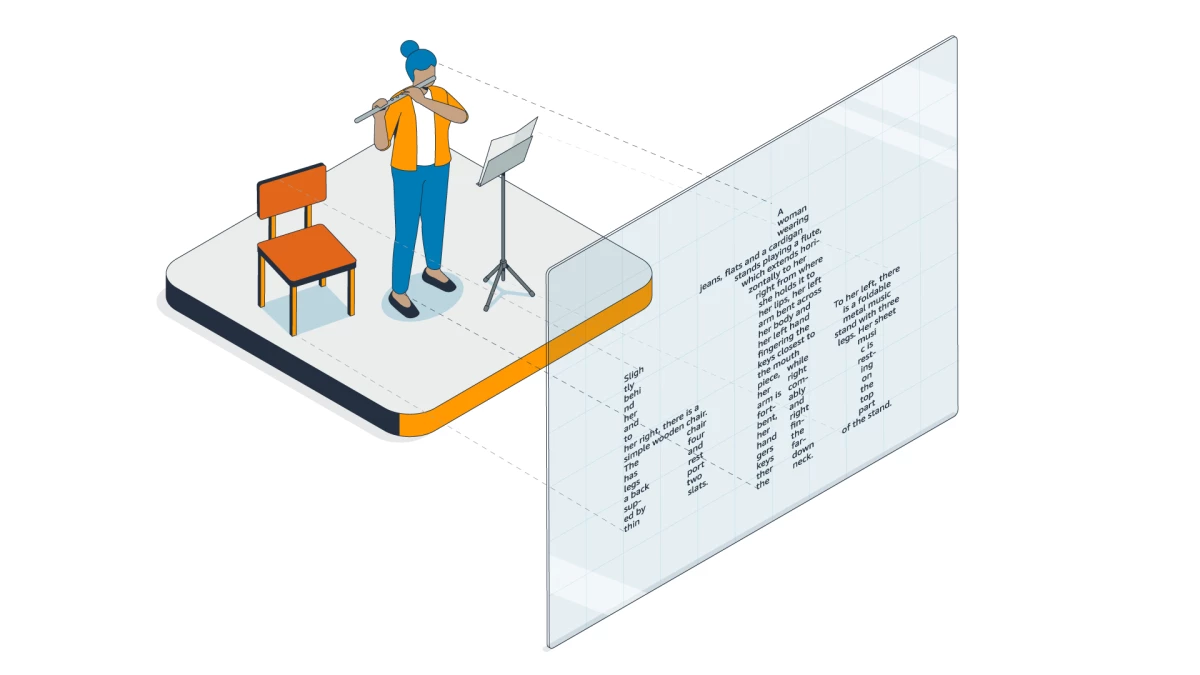

LLM: “Nhìn” Thế giới Qua Lăng kính Ngôn ngữ

Vậy khi LLM phân tích các quỹ đạo và xác suất, liệu có phải chúng đang thực hiện một phiên bản đơn giản hóa của quá trình “ánh xạ” này? Có lẽ chúng đang “nhìn” thế giới thông qua một lăng kính ngôn ngữ, nơi ý nghĩa được mã hóa trong các mối quan hệ thống kê giữa các từ ngữ.

Giống như một bản đồ hai chiều có thể biểu diễn một địa hình ba chiều, LLM có thể nắm bắt được những khía cạnh quan trọng của ý nghĩa, mặc dù không đầy đủ các yếu tố như thị giác, thính giác, xúc giác, khứu giác, vị giác và chuyển động như con người.

“Ngôn ngữ là một công cụ mạnh mẽ để tổ chức và truyền đạt kinh nghiệm,” nhà tâm lý học Steven Pinker đã nhận định. LLM, với khả năng xử lý ngôn ngữ đáng kinh ngạc, đang chứng minh sức mạnh này theo một cách mới mẻ.

“Neuralese” và Thách thức Căn chỉnh với Ngôn ngữ Con người

Điều này không có nghĩa là LLM “hiểu” thế giới giống như con người. Chúng ta không thể nhìn vào “bên trong” LLM để thấy chính xác ý nghĩa nào được gắn với mỗi từ ngữ, cũng như chúng ta không thể nhìn vào não bộ của người khác. Hơn nữa, cấu trúc biểu diễn ý nghĩa của LLM – “neuralese” (ngôn ngữ nội bộ) – có thể khác biệt đáng kể so với cấu trúc ngôn ngữ của con người.

Tuy nhiên, nếu LLM được huấn luyện trên một lượng dữ liệu khổng lồ và đa dạng, phản ánh đầy đủ sự phong phú của ngôn ngữ và thế giới, thì chúng có thể đạt được sự “căn chỉnh” đáng kể với cách con người hiểu.

Kết Luận

Cuối cùng, việc LLM có thực sự “hiểu” hay không vẫn là một câu hỏi mở, một phần cũng bởi vì bản thân khái niệm “hiểu” vẫn còn nhiều tranh cãi. “Ý nghĩa là một mê cung phức tạp, và chúng ta mới chỉ đang ở lối vào,” nhà triết học Daniel Dennett đã viết.

Khi LLM ngày càng phát triển, chúng ta sẽ cần tiếp tục khám phá “mê cung” này, đặt ra những câu hỏi mới, và thách thức những giả định cũ về bản chất của ý nghĩa và sự hiểu biết.

Những nỗ lực này không chỉ giúp chúng ta hiểu rõ hơn về LLM, mà còn soi sáng chính bản thân mình và cách chúng ta tương tác với thế giới thông qua ngôn ngữ.

Lời Kết

Qua hành trình khám phá vừa rồi, chúng ta đã cùng nhau suy ngẫm về khả năng “hiểu” thế giới của các Mô hình Ngôn ngữ Lớn (LLM). Từ những hoài nghi ban đầu về bản chất máy móc của chúng, chúng ta dần thấy được cách LLM tiếp cận ý nghĩa thông qua lăng kính xác suất và các “quỹ đạo” ngôn ngữ.

LLM, dù chưa thể sánh với con người về sự phong phú trong trải nghiệm và khả năng liên kết đa giác quan, nhưng đã cho thấy tiềm năng đáng kinh ngạc trong việc biểu diễn và xử lý ý nghĩa. Chúng có thể không “hiểu” theo cách chúng ta hiểu, nhưng cách tiếp cận độc đáo của chúng mở ra những góc nhìn mới về bản chất của ngôn ngữ và tư duy.

Hành trình này cũng nhắc nhở chúng ta rằng, ý nghĩa không phải là một khái niệm cố định, mà là một dòng chảy liên tục, được kiến tạo bởi sự tương tác giữa tâm trí và thế giới. LLM, với khả năng học hỏi và thích ứng không ngừng, đang tham gia vào dòng chảy đó, góp phần làm phong phú thêm bức tranh đa dạng về sự hiểu biết.

Trong tương lai, khi LLM tiếp tục phát triển, chắc chắn chúng ta sẽ còn nhiều điều để khám phá và tranh luận. Những câu hỏi về ý thức, cảm xúc, và khả năng sáng tạo của máy móc sẽ tiếp tục thách thức những quan niệm truyền thống về trí tuệ và sự sống.

Hành trình tìm hiểu về LLM không chỉ là hành trình khám phá công nghệ, mà còn là hành trình khám phá chính bản thân chúng ta, những sinh vật duy nhất cho đến nay được biết đến với khả năng tư duy, ngôn ngữ, và ý thức.

Bằng cách không ngừng đặt câu hỏi, thử nghiệm và đối thoại, chúng ta sẽ tiếp tục tiến gần hơn đến lời giải đáp cho những bí ẩn về trí tuệ, ý nghĩa, và bản chất của sự tồn tại.

Xem thêm các bài viết cùng chuyên mục AI tại đây!